云优GPU训巨模

文章标题:在云服务器上训练大型模型时,如何优化GPU资源以提高训练效率

一、引言

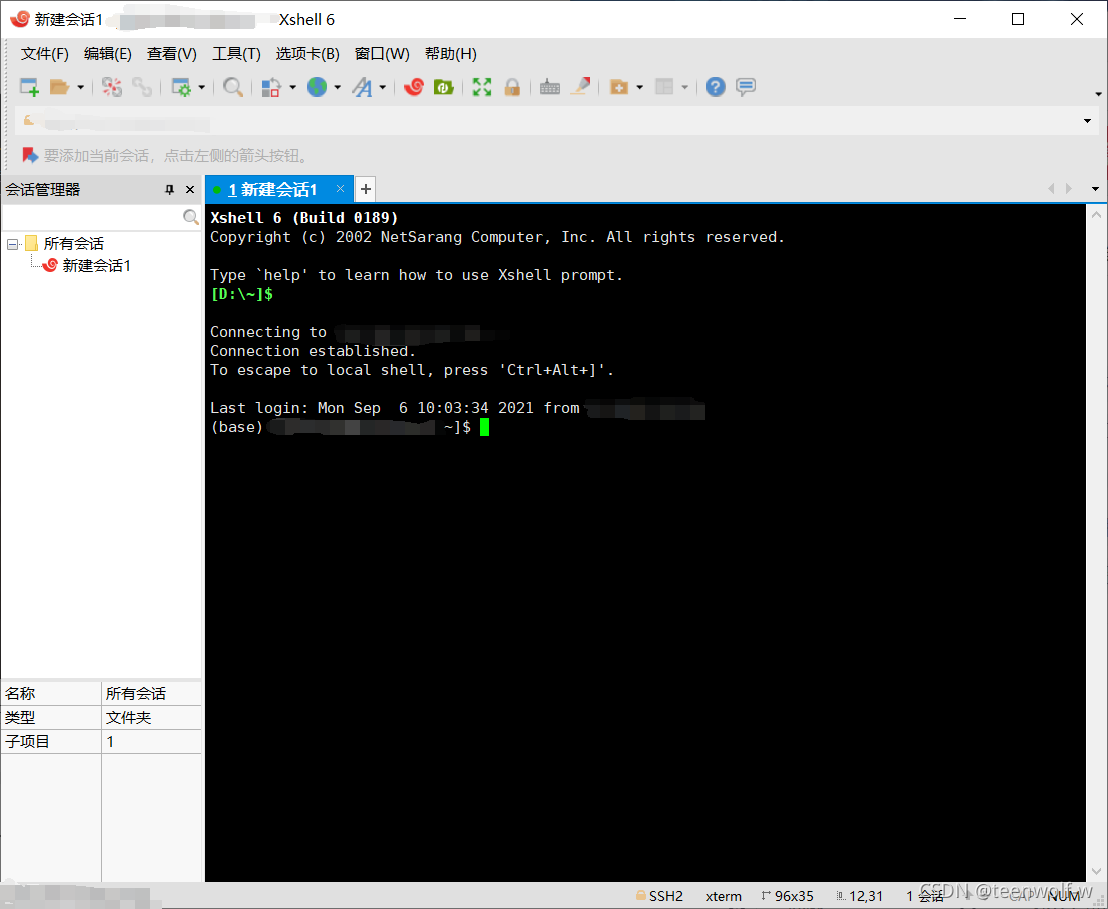

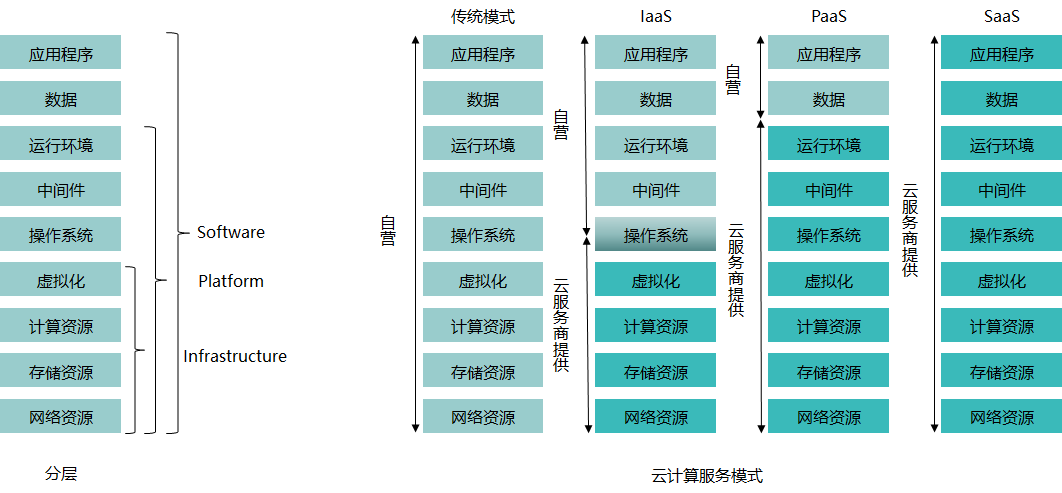

在云服务器上训练大型模型时,GPU资源的优化是提高训练效率的关键。随着模型规模的增大,GPU资源的利用和管理变得越来越重要。本文将探讨在云服务器上训练大型模型时如何优化GPU资源以提高训练效率。

二、了解GPU资源

GPU资源包括GPU型号、显存大小、显存带宽等。在选择GPU时,需要考虑模型的复杂度、数据量以及服务器的硬件配置等因素。在云服务器上训练大型模型时,还需要考虑如何合理地分配和调度GPU资源,以达到最佳的训练效果。

三、优化GPU资源的方法

- 选择高性能的GPU型号

在选择GPU型号时,需要考虑模型的复杂度和数据量等因素。可以选择具有更高计算能力和更大显存容量的GPU型号,以提高模型的训练效率和性能。

- 调整显存分配策略

在训练大型模型时,需要合理分配显存资源。可以采取以下策略:首先,根据模型的复杂度和数据量,计算出每个epoch所需的显存量;其次,根据服务器的硬件配置和带宽情况,合理地分配显存到各个GPU上;最后,采用分布式训练等方式,充分利用GPU资源。

- 利用缓存和分片技术

GPU存在缓存和分片技术,可以进一步提高GPU资源的利用率。可以利用这些技术来减少数据传输次数和延迟时间,提高训练效率。例如,可以利用CUDA的缓存技术来加速模型的计算过程,利用分布式训练等方式来提高GPU资源的利用率。

四、结论

在云服务器上训练大型模型时,优化GPU资源可以提高训练效率。选择高性能的GPU型号、调整显存分配策略、利用缓存和分片技术等都是有效的优化方法。同时,还需要根据实际情况进行调整和优化,以达到最佳的训练效果。